Le cul, on le sait, fait partie des fondations du grand Internet. Et avec l’essor des IA, le cul, forcément, suit aussi. C’est le sujet d’une étude de NBC News qui s’attarde sur la démocratisation des deepfakes et sur les processus d’industrialisation et de monétisation de la production de ces contenus.

À voir aussi sur Konbini

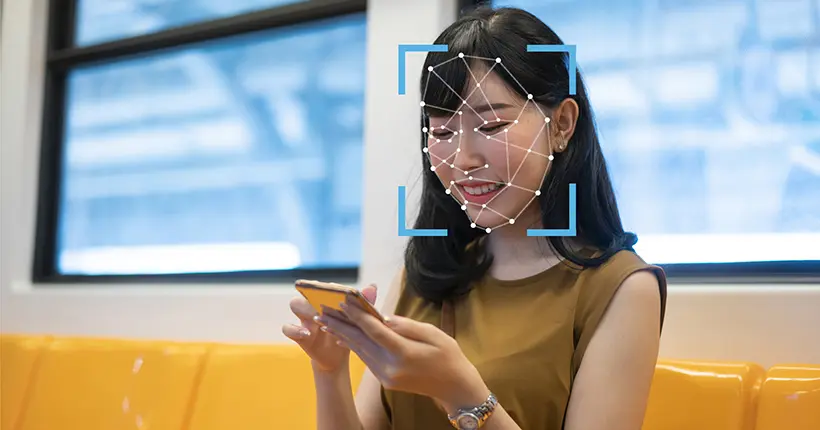

La plupart du temps, les deepfakes correspondent à des vidéos dans lesquelles les visages sont remplacés par d’autres visages, à l’aide d’une intelligence artificielle. Et forcément, ça coince, car selon la société néerlandaise Sensity, “96 % des deepfakes sont sexuellement explicites et mettent en scène des femmes qui n’ont pas consenti à la création du contenu”.

Démocratisation et marchandisation des deepfakes

Aujourd’hui, il existe même des sites spécialisés dans la diffusion de deepfakes à caractère sexuel, facilement accessibles en quelques clics. La production et la diffusion de ces vidéos sont devenues de véritables marchés économiques organisés sur lesquels n’importe qui peut commander, vendre ou acheter. Si les deepfakes visaient principalement des personnalités auparavant, il est désormais possible de faire des commandes personnalisées pour des sommes assez faibles ; “Un créateur a proposé sur Discord de réaliser un deepfake de cinq minutes de qui vous voulez pour 65 dollars”, rapporte NBC News.

Derrière les deepfakes, les victimes

Cette démocratisation est forcément problématique, car ces vidéos peuvent désormais toucher n’importe qui, sans consentement, et peuvent avoir des répercussions graves, tant sur le plan psychologique que sur les retombées qu’elles engendrent dans certains cas. Le magazine MIT Technology Review prend l’exemple d’une journaliste indienne, Rana Ayyub, victime d’une campagne de deepfake porn qui a engendré un “harcèlement en ligne si intense qu’elle a dû réduire sa présence en ligne et donc le profil public nécessaire à l’accomplissement de son travail”.

Les deepfakes peuvent aussi être utilisés dans des cas de “revenge porn”, une pratique qui consiste à diffuser des images pornographiques d’une personne sans aucun consentement dans le cadre d’une “vengeance”. “Une enseignante a récemment perdu son emploi après que de fausses images pornographiques d’elle ont circulé sur les réseaux sociaux et ont été portées à l’attention de son école”, a déclaré “la responsable du service, financé par le gouvernement britannique, d’assistance téléphonique sur le ‘revenge porn'”, Sophie Mortimer, au MIT Technology Review.

Le deepfake porn est aussi une problématique en France. Bien que la loi prévoie la protection des victimes de “revenge porn” et d’usurpation d’identité, les dérives en ligne ne semblent pas encore assez bien contrôlées. En 2022, la streameuse Maghla dénonçait des campagnes de harcèlement à son égard, dont des deepfakes circulant sur différents serveurs Discord.