Dans une interview pour la BBC, l’astrophysicien Stephen Hawking a fait part de ses craintes à l’égard de l’intelligence artificielle.

Stephen Hawking a lâché une prédiction qui fait froid dans le dos. L’astrophysicien britannique, contraint de parler à l’aide d’un ordinateur en raison de la maladie de Charcot dont il est atteint, était au micro de BBC ce mardi 2 décembre. Il s’est notamment exprimé sur l’intelligence artificielle, mettant en garde contre un tel niveau de technologie.

Il a ainsi affirmé :

À voir aussi sur Konbini

Les formes primitives d’intelligence artificielle que nous avons déjà se sont montrées très utiles. Mais je pense que le développement d’une intelligence artificielle complète pourrait mettre fin à l’humanité.

Une fois que les hommes auraient développé l’intelligence artificielle, celle-ci décollerait seule, et se redéfinirait de plus en plus vite. Les humains, limités par une lente évolution biologique, ne pourraient pas rivaliser et seraient dépassés.

Stephen Hawking est considéré comme l’un des plus éminents scientifiques vivants. Il est à la fois connu pour ses travaux dans le domaine de la gravité quantique et de la cosmologie ainsi que pour ses oeuvres de vulgarisation scientifique. Si son avertissement est fort à l’égard des nouvelles technologies, il n’en est pas moins l’un de ses premiers utilisateurs, se revendiquant l’un des premiers à avoir été “connecté” à Internet.

À ce propos, le scientifique voit dans Internet le terreau de terroristes et de criminels :

Les entreprises d’Internet doivent faire plus pour contrer la menace, mais la difficulté est de le faire sans sacrifier la liberté et la vie privée.

Le cinéma l’avait déjà annoncé

Il est étonnant que cette annonce se fasse en corrélation avec une actualité cinématographique qui a abordé en 2014 l’intelligence artificielle sous pas mal de coutures. En mars, le nouveau film de Spike Jonze, Her, évoquait la relation entre un humain et une intelligence artificielle. Il racontait ainsi, façon comédie romantique, la manière dont le système d’exploitation OS1, aka “Samantha” (Scarlett Johansson), élargissait progressivement ses connaissances, devenant conscient de lui-même et délaissant l’humain Theodore Twombly (Joaquin Phoenix).

Dans un autre genre, en juin, Transcendance de Wally Pfister donnait une vision plus pessimiste du futur, en droite ligne des prévisions de Stephen Hawking. Il suffit de lire son scénario pour s’en convaincre : le Dr Will Caster (Johnny Depp), atteint d’un virus, se voyait muter en intelligence artificielle.

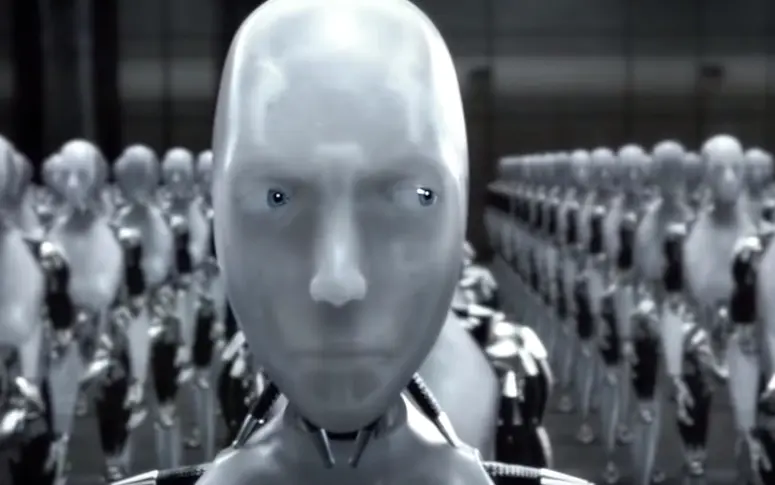

Son accès sans limites aux technologies et aux réseaux font alors de lui un danger pour la Terre, les humains se retrouvant dépassés par une nouvelle forme de vie, ici une singularité technologique. Une vision aussi pessimiste que celle de 2001, l’Odyssée de l’espace de Stanley Kubrick ou Terminator de James Cameron, dans laquelle les robots ont toujours le mauvais rôle.

Et si l’intelligence artificielle était une chance ? Et si Interstellar, le dernier Christopher Nolan, était le plus à même de décrire le futur des intelligences artificielles sans tomber dans la dystopie ? TARS, le nom du robot-assistant dans le film, ne ressemble à aucun robot déjà vu au septième art : il n’a pas un physique humanoïde et n’a pas une intelligence qui va dépasser ou compléter celle des humains. Au contraire : TARS peut en remplacer un, en cas de besoin, comme un humain ordinaire.

Un robot réaliste, donc, qui ne ressent pas les émotions et dont la transparence (ses paramétrages sont facilement modulables), comme l’explique le journaliste Miles Brundage de Slate, éviterait les complications qui ont souvent lieu dans les films de science-fiction, de HAL à Skynet.

Et si, finalement, le principal mot d’ordre devait être le contrôle de l’intelligence artificielle ? Un certain Isaac Asimov avait déjà imaginé cette donnée dans ses romans, via trois règles auxquelles les robots devaient être toujours soumis. Il les avait appelées les lois de la robotique.