Tabasser les gros et les roux ? OK. Tuer Trump ? Pas OK.

Voici donc ce que le Guardian a appris, au fil de centaines de documents détaillant avec plus ou moins de précision quelle attitude adopter face à tel ou tel contenu. Premièrement, dans les cas relatifs à la violence graphique, l’automutilation et l’appel au meurtre, Facebook adopte une position carrément laxiste : les vidéos d’automutilation (live inclus), de violence envers les animaux, de morts violentes, de maltraitance d’enfants “non sexuelle” ou d’avortement (“tant qu’il n’y a pas de nudité”) sont parfaitement autorisées, au motif qu’elles permettent parfois de dénoncer ou de sensibiliser (dans le cas des vidéos d’abattoirs de L214 ou de la guerre en Syrie, par exemple). Quand aux vidéos de mort violente, Facebook les laissera en ligne mais préviendra ses utilisateurs que le contenu est “sensible”. De manière générale, le réseau social place la limite morale à la présence de sadisme et/ou de célébration de la violence. Sans cela, tout est a priori autorisé. Vous n’avez donc pas fini de voir des saloperies en lecture automatique vous couper l’appétit à n’importe quelle heure de la journée.

En ce qui concerne les appels au meurtre, il est par exemple interdit d’appeler à “buter Trump”, car celui-ci est protégé par son statut de représentant de l’État, mais donner des instructions précises sur la meilleure manière de “briser le cou d’une connasse”, par exemple, est parfaitement toléré, car Facebook demande à ses modérateurs de juger la crédibilité d’une menace… et hiérarchise les cibles : menacer une minorité est prohibé, mais menacer monsieur ou madame Tout-le-monde est autorisé, au motif que “les gens expriment souvent leur dédain ou leur désaccord en menaçant ou en appelant à la violence de manière facétieuse et peu sérieuse”, selon l’entreprise. Exemples concrets fournis par la compagnie : “frapper un roux” ou “tabasser des gros” est autorisé, mais “#poignarde et devient le cauchemar des sionistes” est prohibé. Ici, le réseau social organise clairement un système à deux poids, deux mesures entre vous et les personnages publics. Si vous voulez signaler du harcèlement vis-à-vis de votre petite personne, bonne chance – Facebook partira du principe que la menace n’est pas sérieuse.

À voir aussi sur Konbini

La nudité, du revenge porn aux œuvres d’art

Encore plus complexe, du moins pour Facebook, la question de la nudité. Contrairement à la violence verbale et physique, pour laquelle le réseau social aurait plutôt tendance à la jouer libertaire, il devient étonnamment pudibond dès qu’il s’agit d’un corps en tenue d’Ève ou d’Adam – on l’avait déjà constaté avec son aversion pour les tétons des femmes. Submergé par l’explosion du revenge porn – cette pratique humiliante qui consiste à balancer sur Internet les sexpics soutirées à son conjoint ou sa conjointe –, Facebook tente de lister les caractéristiques qui définissent une photo de nu comme un acte dégradant (et vu l’omniprésence de la sexualité dans l’iconographie publicitaire contemporaine, on les comprend) : l’image doit être produite dans l’intimité, la personne doit être représentée nue, partiellement nue ou en pleine activité sexuelle, et l’absence de consentement doit être confirmée par un “contexte vengeur” (incarné par une légende ou un commentaire moqueur) ou par le traitement de l’affaire par un média.

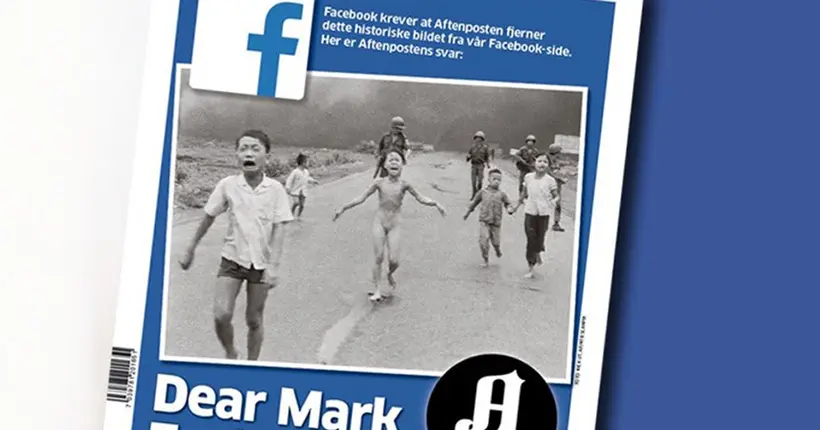

Quant aux autres formes de nudité, notamment en photo (l’affaire de la censure de la photographie de la petite Vietnamienne brûlée au napalm avait fait scandale), Facebook choisit d’imposer une limite parfaitement arbitraire entre le publiable et l’indécent : lorsqu’il s’agit d’“œuvres d’art” réalisées à la main (peintures, collages, dessins…) dépeignant des pratiques sexuelles et/ou de la nudité, ça passe, mais les photos sont soumises à une plus grande sévérité. Pour qu’elles aient l’honneur d’apparaître sur la plateforme, les photos exposant de la nudité doivent être dans le cadre d’un contexte d’actualité ou historique – Facebook prend l’exemple de l’Holocauste et autorise la publication de survivants nus. Au-delà de ça, la nudité photographique reste extrêmement restreinte.

Censeur ou propagandiste, l’impossible dilemme

Avec la publication de ces “Facebook Files”, le Guardian offre enfin des éléments de réponse concernant la gestion du contenu sur le plus grand réseau social du monde, lequel refuse obstinément de se définir comme un média d’information et d’endosser une quelconque responsabilité dans les activités de ses membres. Et ce que ces documents nous montrent n’est pas rassurant : des équipes surmenées avec un rythme de modération infernal, des catégorisations arbitraires de personnes, de la psychologie pour le moins “simpliste”, une interprétation cynique de la morale et une pression démentielle des utilisateurs – selon l’un des documents, Facebook traiterait 6,5 millions de dénonciations de faux comptes par semaine. L’entreprise semble complètement dépassée.

Le tout dans un contexte de pression accrue des gouvernements, tant aux États-Unis qu’en Europe, où Facebook est désormais sommé d’agir pour modérer plus efficacement le contenu violent sous peine d’amende. Une position difficilement tenable pour l’entreprise : si elle conserve sa ligne libertaire, elle passera pour un organe de propagande de fake news et d’imagerie terroriste ; si elle décide de modérer son contenu de manière réellement coercitive, elle passera pour le plus grand censeur de la planète. Pour le moment, incapable de choisir, Facebook est tout ça à la fois. Et le dilemme n’a pas fini de hanter ses responsables.