Publicité

Malgré les lignes de codes et les algorithmes, derrière une voiture autonome, il y a de l’humain, avec son lot de subjectivité et de défaillances. Les questions liées à l’éthique et à la sécurité commencent déjà à se poser, avant même que le futur ne soit vraiment là.

Publicité

Le problème des biais algorithmiques, qui s’étend bien au-delà du cas précis des voitures autonomes, revient régulièrement sur le devant de la scène. Parce qu’une bonne partie d’entre eux est façonnée par des mâles blancs de la Silicon Valley, on s’est rendu compte que les algorithmes pouvaient, sans intention délibérée, être racistes ou machistes. Et ce principalement parce que l’on travaille avec de la data biaisée, ne reflétant pas assez la diversité et rendant ainsi les algorithmes plus aptes à traiter certaines données que d’autres.

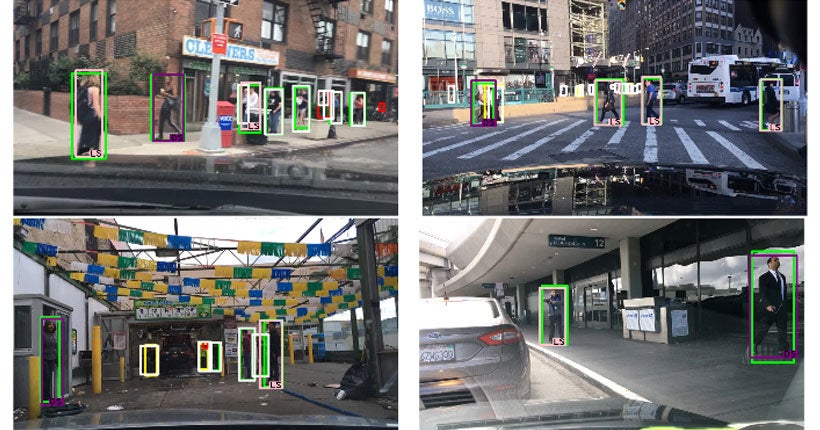

Pour revenir à la voiture autonome, un exemple flagrant est rapporté par trois chercheurs du Georgia Institute of Technology, à Atlanta. Leur travail de recherche, intitulé “L’Inégalité prédictive dans la détection d’objet“, a été publié sur la plateforme de prépublication Arxiv (c’est-à-dire que les pairs n’ont pas encore approuvé l’étude) et nous montre que certains algorithmes de reconnaissance d’image sur des piétons identifient mieux les personnes à la peau claire.

Publicité

Résultat : les algorithmes testés par les chercheurs perdent 5 % de précision sur les piétons à la couleur de peau foncée. Ce qui, en gros, voudrait dire que ces mêmes algorithmes introduits dans une voiture autonome pourraient repérer plus facilement une personne blanche qui traverse la rue qu’une personne noire.

Vox, qui a relayé l’article, attire notre attention sur une des modalités de réalisation de l’étude qui a toute son importance : les datasets des images de piétons et les algorithmes utilisés ne sont pas nécessairement ceux utilisés par les constructeurs de voitures autonomes, ce sont des outils libres mis à la disposition de tout le monde, et notamment des universitaires.

Pourquoi ne pas avoir utilisé directement les algorithmes des constructeurs ? Pour la simple et bonne raison qu’ils sont jalousement gardés par leurs propriétaires. Pour l’heure, les cerveaux des voitures autonomes sont des boîtes noires rétives à la transparence. Conception du progrès contre laquelle s’élèvent de nombreux chercheurs et instituts à l’instar d’Open.ai, qui milite pour une intelligence artificielle “sûre”.

Publicité

Cette même transparence pourrait être exigée pour une autre raison : les voitures autonomes seront amenées à faire des choix cruciaux en cas de dilemme. Qui faudra-t-il sauver en priorité ? Un jeune, un vieux ? Des millions de personnes consultées s’étaient exprimées sur la question. Et, jusqu’à ce jour, seule l’Allemagne s’est dotée d’un attirail législatif visant à encadrer ces choix. Mais même l’Allemagne n’exige pas la transparence dont rêvent les voix critiques.